-

Live �߱� �� �������

AI�� ������ ������ å�Ӽ� �����ϴ� ���� �ʿ�

� �ߴܵ� AIê�� ���̷�١������� ����� ���� ������ �Թ� �����ؾ�

- ����Է�2021-02-17 19:00

ä�μ� ���� (iscra79@junggi.co.kr) �ٸ���纸��

-

AI(�ΰ�����) ���� ��ŸƮ�� ��ij�ͷ��� ������ 12�� ����� AIê�� ���̷������, ���� ���ε��� ���� ��ȭ ������ ��� ������ ������� ê���� �н����� �ڿ������� ����� ��ȭ�� ���� �� �ֵ��� �ߴ�. ���� ��� �� 20�� ���� ���л����� ������ �̷�ٿ� ���� �ɰ��� ���� ���ȭ�� ������ �ǰ�, ������ �����ܰ迡�� ����������ȣ�� ���� ��Ȥ�� ����ƴ�. �� �̷���� ��ȭ���� �� �ΰ��� ���� ����, ������ �����ϴ� �߾���� ��Ÿ����, �ᱹ ���� 3�� ���� ��� �ߴܵƴ�.

�ΰ������� ��ó�� ���� �о߿��� �پ��� ��ǰ�� ���� ���ȭ�ǰ� �ִµ�, �ڷγ�19�� ���� ����ȭ�� ������ ��ȯ���� �� �ӵ��� ���ӵǰ� �ִ�. ���� �ΰ����� �˰����� ������ ��ǰ �� ���� ���������� ���Ӿ��� ���ϰ� �ִ�. �ΰ������̶�� ���� ����� ���� ��ȸ�� ���� �� ���ο� �Թ�ü�谡 �ʿ��� �����̴�.

���� ��������, ���輺�� ����� �����ϰ� �ǹ� �δ� �ʿ�

�ΰ����� �ý����� ������� ��踦 ���ʶ߸��� �پ��� �����Ϳ��� ������ �������� ���� �ΰ����� �ظ� ��ĥ �� �ִٴ� ������ ���� ������ ��εǰ� �ִ� ���, ���Ҿ���ִ� �������Ư�������� ���ʸ� �ǿ��� �κ� ��������������ȸ, �����αǿ����� ���� ���ΰ������� ����������������å�Ӽ� ������ ���� ���� ������ ���ȸ�� 17�� �����ߴ�.

������ ������б� ���������� ��ȣ��� �̳� ���ȸ���� ������������������å�Ӽ� ������ ���� �ΰ����� �����������̶�� ��������, ���ΰ����ɰ� ������ �������� �� �̱��� �ܼ� ���縦 �ϴ� ���� �ƴ� ����������������å�Ӽ��̶�� ū Ʋ�ȿ��� �ſ� ��ü���� ���̵������ �� ���Ұ�, �� �ȿ��� ���� �Թ� ������ ���� �پ��� ����� ����ִ����� �Ұ��ߴ�. ���� ���츮������ �ΰ����� ���� ���� ���� �� �ε���� ��ǥ������, �����̰� ���������� �ʿ��� ������ ������ ���� ������ �ΰ������̳� ���������� �־�� ������ �������� �ִ� �Թ��� �ʿ��� ���� �̶�� �����ߴ�.

���� �ֱ� �������� �ΰ����ɰ� ������ ���� �ý��� ���ǰ� ��â�̴�. ���� ��ȸ���� �ΰ����ɰ� ������ ������ �� ��å���� �� �Ź��ͽ� ������ ������ ������ �̻������������������ �ǿ� ���� ��ǥ �����ߴ�.

������ �̵� �������� ���������� �ΰ����� ����� ����̳� ��������� �����ϴ� ���� �ֿ� ��ǥ�� �ϰ� �ִ� ���� ����������� ġ���� �ִ�. ���� �ΰ������� �߱��ؾ� �� ��Ģ���� �㺸�� ���뿡 ���� ������ �����ϰ�, �ΰ����ɰ� ��ȣ�ۿ��ϴ� ������ ���� ��ü���� ������ ã�ƺ��� ��ƴٴ� ���� �� ��ȣ���� �����̴�.

��, ���ΰ� ������ 12��24�� ��ǥ�� ���ΰ����� �������������� ���� �ε������ ��� ������ ��������������ü�踦 �켱 �����ϰ�, ���� �˰������� ���⼺ ���� ���������� �� �ִ� ü�踦 �����Ѵٴ� �������� ������ �ִ�. �÷��� ����� ������ ��ȭ�� ���ؼ��� ��������� �����ϸ鼭�� �˰������� ������ ���۹����� ������ ��� ������ ���̵���� ���� �� �ʿ�� ���������� �ϰڴٴ� ��ȹ�� ��ǥ�ߴ�.

���� �� ��ȣ��� �� �ε�ʿ� ������ �⺻���̳� ����� ������ å�� �� �Һ��� ��ȣ�� ���� ���� ��������� ������ �ִٰ� �ߴ�. ����� �������� �߿�������, ������ ��� ������ �ñ�� �ͺ��ٴ� ������ ��� ���� ������� ���� ���輺�� ����� �����ϰ� ���� �ǹ��� �δ��ϰ� �� �ʿ䰡 �ִٴ� ���̴�.

���� ������å�ӹ�, �Һ��ں�ȣ�� �����δ� �����ذ� �Ѱ���

�� ��ȣ��� ���ֱ� �̽��� �� �̷�� ������ ��� ����������ȣ���� �ؼ������ε� �Ʒ� ������ ���� �̿�ܰ��� ���� ���� ������ �� �־��� �����̶�鼭��, ������ ������å�ӹ��̳� �Һ��ں�ȣ�� �� ���� ���ɰ� ���������� �ΰ����� ��� Ȱ�뿡 ���� �������� ��� �ذ��� ���� �������� �����ߴ�.

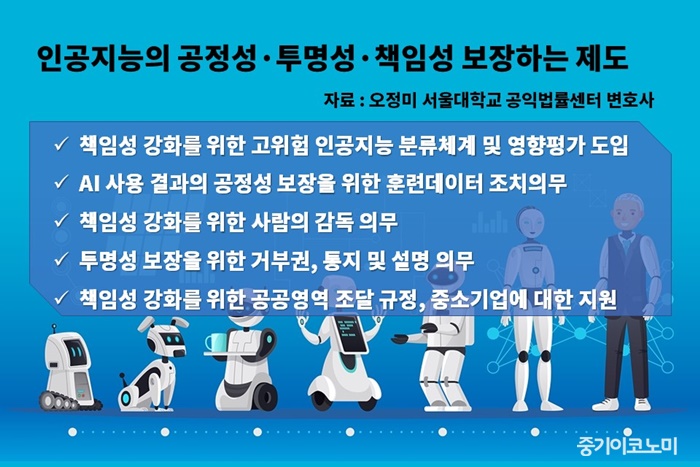

��ü���� ���� ���� �������δ� ��å�Ӽ� ��ȭ�� ���� ������ �ΰ����� �з�ü�� �� ������ ���� ��AI ��� ����� ������ ������ ���� �Ʒõ����� ��ġ�ǹ� ��å�Ӽ� ��ȭ�� ���� ����� ���� �ǹ� �������� ������ ���� �źα�, ���� �� ���� �ǹ� ��å�Ӽ� ��ȭ�� ���� �������� ���� ����, �ұ���� ���� ���� ���� �����ߴ�.

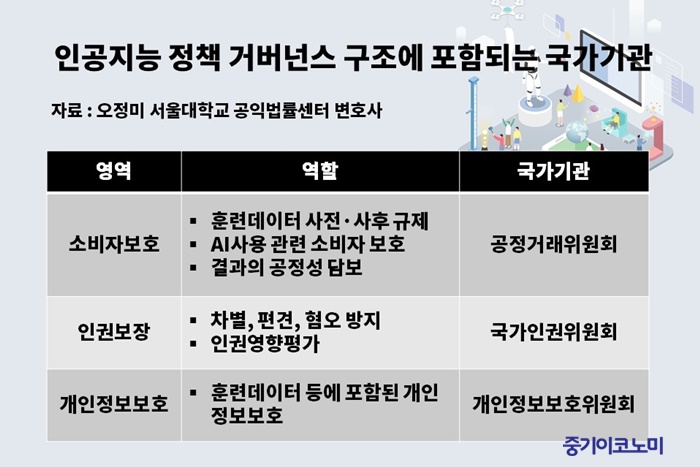

�̿��Բ� �Ź��ͽ� ������ �־�� �Һ��ں�ȣ, �αǺ���, ����������ȣ ������ �����ϱ� ���� �����ŷ�����ȸ�������α�����ȸ������������ȣ����ȸ �� �پ��� ���ش������ ������ �����ؾ� �Ѵٰ� �ߴ�. �߱����ڳ�� ä�μ� ����

ڸ��EU, �ΰ����� ������ ������ ������ ���� Ȱ���ܱ��� ��� �ΰ����� ���� ���� �� ������ ������ ������ ���ǰ� Ȱ���ϴ�. ��ǻ�� ������ å�Ӽ����������������� ������ ���� ����ȸ���� ACM�� ��FAT ���۷������� �ΰ������� ���Ѿ� �� ��Ģ���� ������(Fairness)��å�Ӽ�(Accountability)��������(Transparency)�� ������ ��FAT ��Ģ���� õ���ߴ�.

���������� 2019�� ���ŷ��� �� �ִ� AI�� ���� ���̵�������� �����, 7���� �ٽ����� �䱸������ �ݿ��ϴ� ����(Communication)�� �߰��ߴ�. �� ������ ���ΰ��� ��ü�� ������ ���� ������� �߰��� �� ������ �������̹��� �� ������ �Ź��ͽ� �������� ���پ缺, ������ �� ������ ����ȸ����ȯ���� ���� ��å�Ӽ��̴�.

������ 3������ ���ΰ����� ������ �ŷڸ� ���� �鼭���� ������. �鼭���� ���� �� ���ɼ��� ���� �о��� �ΰ����ɿ� ���� ���� ������ ����� �����ϰ�, ���� ���ռ� �� ���� �ϴ� ����� �����ϰ� �ִ�. ���� EU�� ���¶��� �÷��� ������ ������ �� ������ ��ȭ�� ���� 2019�� EU �̻�ȸ ��Ģ���� ������ ������ 7������ �����ϰ� �ִ�.

�̱��� ��� ���� �������� �˰����� ������ ���� ������ ���ǵ�����, �ֿ� ���� ���������� �ΰ����� �˰����� ���� ������ ����ǰ� �ִ�.

�̱� ��������� 2019�� 4�� ���ΰ����� ����� �˰����� ������ ���� �˰����� å�ӹ������� ������ ������ �������̴�. �� ����ŷ�����ȸ�� ������ 4�� ��ǥ�� ��AI �� �˰����� �����ħ���� ����� AI �� �˰������� ����� �� �������� ������ ���ɼ� �������� ���߰����� ������ Ÿ�缺 ��å�Ӽ��� ���ߵ��� ������, �ؼ��ؾ� �� ���뵵 ��ü������ �����ϰ� �ִ�. �߱����ڳ�� ä�μ� ����

<���۱��� �� �߱����ڳ��. �������� �� ����� ����>

- ���ñ�� �� �Ƿ� �ΰ����ɿ� ���� �źΰ� �غ� �����塯

- ���ñ�� �� �ΰ�����, ���� ���� �߰ߡ��Ƿ� �� ���� ����

- ���ñ�� �� �ΰ�����, �����Ϳ� ����� Ưȭ���簡 Ű����

- ���ñ�� �� �۷ι� �ֵ��� ġ�����ΰ����� ������ �� ����

- ���ñ�� �� �߱�, �ΰ����� �����Ϸ��� AI �÷����� �Ǹ���

- ���ñ�� �� �����ΰ� ������ǰ ����� ���۳� ����ϴ١�

- ���ñ�� �� �丮�簡 �ֹ� �ʿ��ϵ� �����ڿ��� �÷�����

- ���ñ�� �� ���̰��� Ű� ������, ���ĺر� �ñ� â�� ���

- ���ñ�� �� �ΰ����� �����? ����ó�� ������ �� �ֽ��ϴ�

- �������ֱǡ������̺����� ���� ����� ���١�

- ��ȭ����ν����̽�, �쿬�� ���� Ž�� ����

- �߱��, �����Ͼ� ���� ��� 50�� �ű� ����

- '����ó�� ����' ��Ʃ�����ڵ� ���̸� ���Ծȵ�

- ���� ���������� ����� �Ű��� �����δ�

- �ΰ�����(AI) Ȱ���� �������翡 ������� �ο�

- û����� ���ϱ� ���� �����ұ������ ���캸��

- �ϰ������ֱ� 4�� ���硦��¡�� 935��� �ΰ�

- ��K-��ī ������ �����̾� ����Ʈ ������ ����

- ��CJ �ڻ��� �Ұ����ø��꿵 �պ�...�����ġ ������